Voicebox:把 ElevenLabs 的语音克隆体验搬到本地(还带时间线编辑和 API)

如果你用过 ElevenLabs,你大概率会被两件事卡住:

-

隐私:声音样本要上传云端,越用越心虚 -

成本/限制:订阅、额度、API 计费、条款……一旦开始依赖就很难回头

jamiepine/voicebox(https://github.com/jamiepine/voicebox[1])的定位非常直白:开源、本地优先的语音合成工作室。

它不是“一个 TTS demo”,而是想做成一个真正可用的工作台:

-

下载模型 -

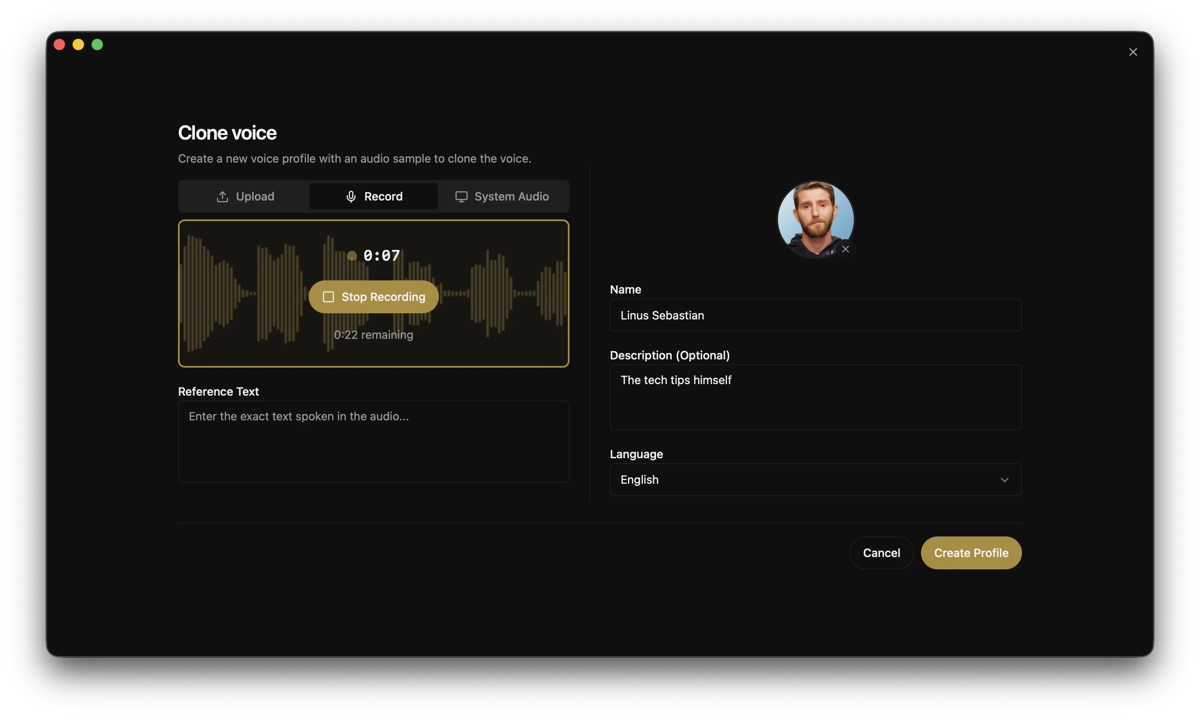

用几秒音频克隆成一个 voice profile -

生成语音 -

进时间线编排成多角色对话/播客 -

还可以用 REST API 接进你自己的应用

先给你一个靠谱的判断:它活跃吗?能放心用吗?

基于 GitHub 数据(写作时刻):

-

Stars:12,297 -

Forks:1,400 -

创建时间:2026-01-25 -

许可证:MIT

一句话解读:热度很高、开源友好,属于“你可以先下载跑起来,再决定要不要深度集成”的项目。

Voicebox 到底是什么:它想替代的不是 TTS,而是“语音生产工作流”

Voicebox 的官方描述是:The open-source voice synthesis studio。

它强调几个关键点:

-

Local-first:模型和语音数据都尽量留在你的机器上(不依赖云服务锁你数据)。 -

DAW-like:不是只给你一个输入框,而是给你“像音频工作站一样”的时间线能力。 -

API-first:桌面 App 之外,还能让你把语音能力接进产品里。

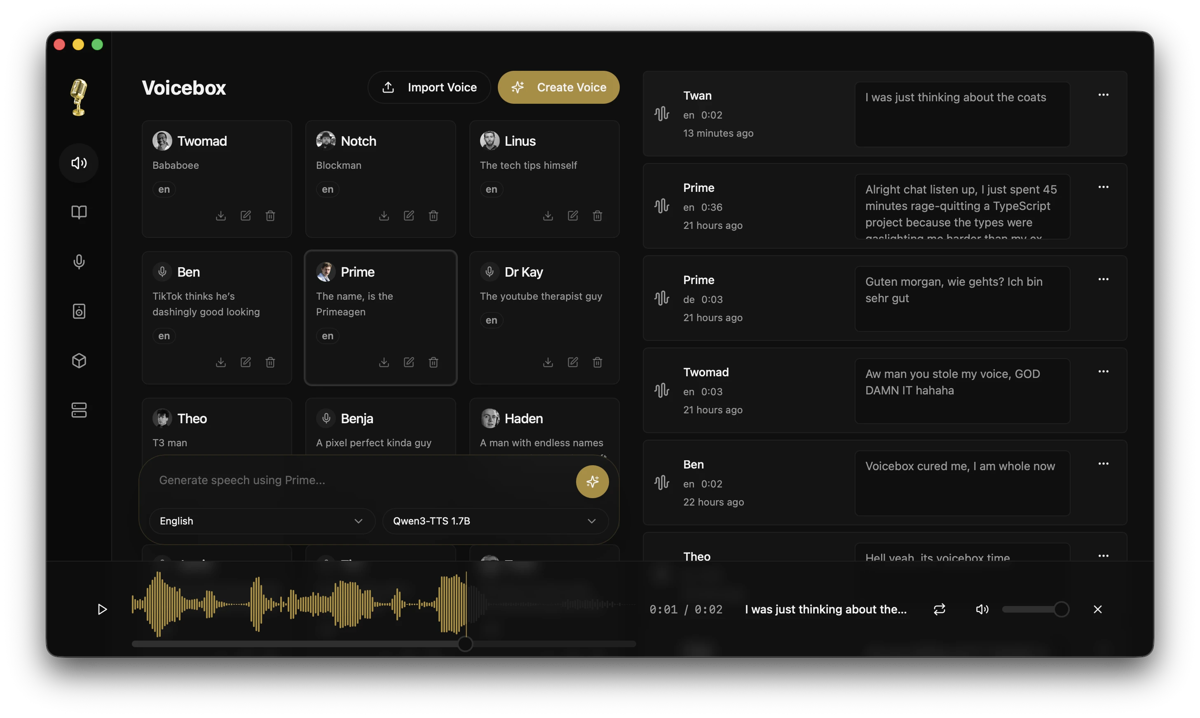

下面这几张截图(来自项目官网/仓库)能直观感受它的“工作台感”:

它现在能做什么(按你可能会用到的场景讲)

1)本地语音克隆 + 语音生成(当前主力:Qwen3-TTS)

仓库里写得很明确:目前主力模型是 Qwen3-TTS,后面计划支持 XTTS、Bark 等更多模型。

对你来说,重要的是“能不能用、怎么用、好不好接”。Voicebox 给的是一套可落地的产品形态:

-

上传音频样本 → 得到一个 voice profile -

用这个 profile 生成语音 -

支持批量生成(适合长文/旁白)

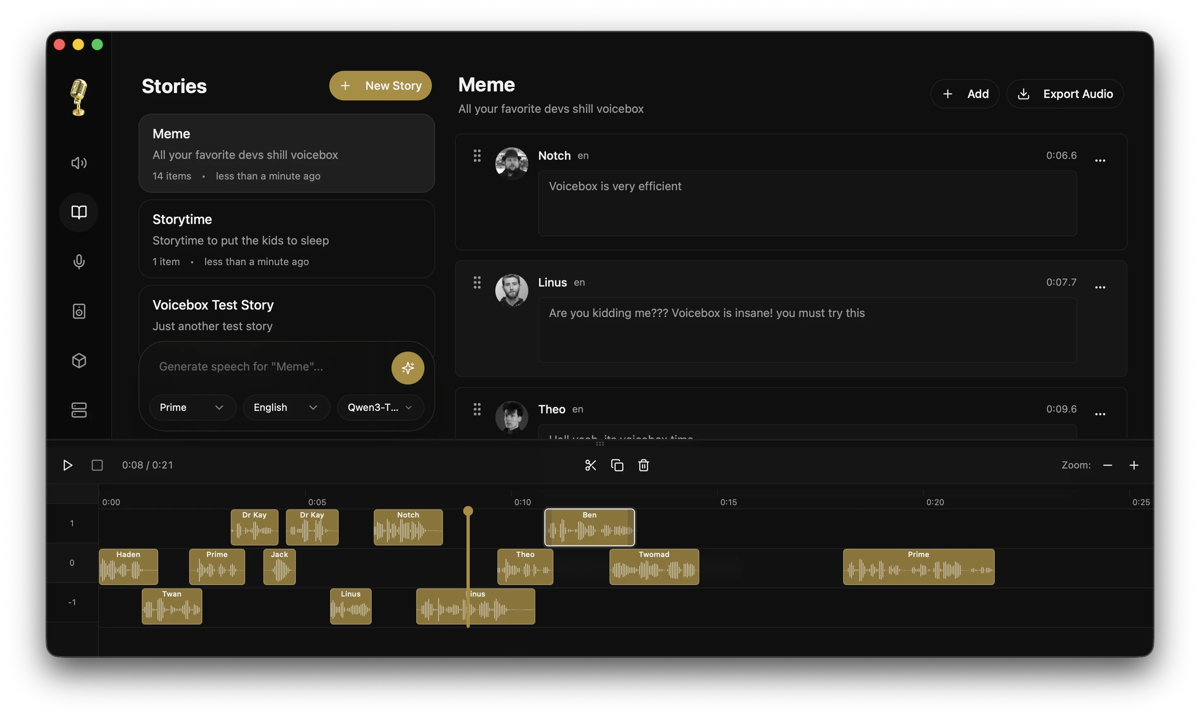

2)Stories Editor:用时间线做多角色对话/播客

它专门有一个 Stories Editor:

-

多轨道编排 -

时间线内裁剪、分割 -

预览播放

你做播客、剧情短片、产品 demo 配音时,这类“编排能力”比单纯 TTS 更值钱。

3)录音 + 转写(Whisper)

仓库写明支持:

-

应用内录音 + 波形 -

系统音频采集(macOS/Windows) -

Whisper 自动转写

如果你要做“录音 → 生成稿 → 二次配音/改口播”,这条链路就很顺。

4)REST API:把语音能力接进你自己的产品

Voicebox 暴露了完整的 REST API,并且后端默认会提供 http://localhost:8000/docs 的接口文档。

仓库里给了最小可跑的示例(我原样保留):

# Generate speech

curl -X POST http://localhost:8000/generate \

-H "Content-Type: application/json" \

-d '{"text": "Hello world", "profile_id": "abc123", "language": "en"}'

# List voice profiles

curl http://localhost:8000/profiles

# Create a profile

curl -X POST http://localhost:8000/profiles \

-H "Content-Type: application/json" \

-d '{"name": "My Voice", "language": "en"}'

你可以把它当成:

-

游戏/NPC 对话系统的语音层 -

企业内部工具的语音播报 -

内容生产流水线(脚本驱动配音)

三条“拿来就能用”的路径(你照着做就行)

路径 A:10 分钟试用——验证效果和体验

-

去 Releases 下载对应系统的安装包:https://github.com/jamiepine/voicebox/releases[2] -

导入一段你自己的音频样本(几秒即可)创建 profile -

输入文本生成一段语音 -

试试把两段语音放进时间线(你会立刻知道它是不是“工作台”)

路径 B:内容创作——旁白/播客/对话短片

-

准备 2~3 个声音 profile(主持人/嘉宾/旁白) -

先把文本拆成段(每段一句话或一个小节) -

在 Stories Editor 里按轨道编排 -

导出音频,进剪映/PR 或直接发布

这条路径的核心收益是:你不用“生成一堆 wav 再手动对齐”,时间线能省大量体力活。

路径 C:产品集成——把语音变成一个内部服务

-

在一台性能更强的机器上跑 Voicebox server -

业务侧调用 REST API(生成语音/列 profile/创建 profile) -

把生成结果写进对象存储/缓存层

适合的典型场景:

-

客服话术、报表播报 -

课程/培训内容自动配音 -

游戏对话与剧情系统

顺手讲清楚:它为什么跑得快(尤其是 Mac)

Voicebox 的一个“很工程化”的点是:它不是 Electron,而是 Tauri(Rust)。

另外仓库也明确写了:在 Apple Silicon 上支持 MLX backend + Metal 加速,主打 4~5 倍更快的推理体验;在 Windows/Linux/Intel 等场景下则走 PyTorch。

这意味着:

-

Mac 用户更容易获得“能用且快”的体验 -

你做本地语音生产,延迟和迭代速度会显著影响效率

最后:我建议你怎么判断“要不要把它纳入自己的生产流程”

别纠结模型参数,按三条线判断就够了:

-

隐私/合规:你的声音数据能不能上云?不能就选 local-first。 -

工作流:你需要的是“生成一段语音”,还是“持续生产一批可编排的语音资产”?后者更需要 Voicebox 这种工作台。 -

集成难度:如果你最终要接产品,REST API + 本地/远程模式会比纯网页工具舒服得多。

如果你想快速上手,直接从 Releases 下载跑起来就行;如果你打算做更深的集成,建议先把 /docs 的 API 过一遍,确认接口形态符合你的调用习惯。

引用链接

[1]https://github.com/jamiepine/voicebox

[2]https://github.com/jamiepine/voicebox/releases

发表回复