Project N.O.M.A.D.:一台把离线资料、本地 AI、地图和课程装进家里的开源服务器

- Prompt / Skills / 配置

- 12天前

- 34热度

- 0评论

- 项目名:Project N.O.M.A.D.

- GitHub:https://github.com/Crosstalk-Solutions/project-nomad

- 增长信号:2025 年 7 月发布 1.0.0,2026 年 3 月已经迭代到 1.30.1,近 30 天还在持续修 GPU、下载、存储显示和安全相关问题

- 一句话判断:它可以理解成一台本地离线知识服务器,把离线维基、本地 AI、地图、课程和资料检索装进同一个系统里

你可以把它理解成一台本地离线知识服务器:提前把资料、地图、课程和 AI 能力装进去,断网之后还是能继续查信息、学习、看地图、问问题。

如果只看仓库名,确实不容易一下子明白它是干什么的。更直白一点说,Project N.O.M.A.D. 做的是一套“装在你自己机器上的离线信息系统”。

它能做的事情其实很好理解:

- 在本地放一套离线 Wikipedia 和其他资料库

- 放一个不依赖云端的 AI 问答助手

- 放离线地图,没网时也能继续查位置

- 放课程和学习内容,拿来做家庭学习机

- 放你自己的 PDF、手册、文档,后面直接检索和提问

所以它更适合三类场景:家庭学习机、离线资料库、应急信息终端。等你接受了这个定位,再回头看它下面那些组件和架构,理解就会顺很多。

项目卡

- 项目名:Project N.O.M.A.D.

- GitHub:https://github.com/Crosstalk-Solutions/project-nomad

- 增长信号:2025 年 7 月发布 1.0.0,2026 年 3 月已经迭代到 1.30.1,近 30 天还在持续修 GPU、下载、存储显示和安全相关问题

- 一句话判断:它可以理解成一台本地离线知识服务器,把离线维基、本地 AI、地图、课程和资料检索装进同一个系统里

我一开始以为它只是把 Kiwix、Ollama 这些现成组件打个包。往下看之后才发现,它真正有信息量的地方,是自己做了一层 Command Center:安装、配置、更新、内容下载、知识库、基准测试,尽量都收进一个浏览器界面里。

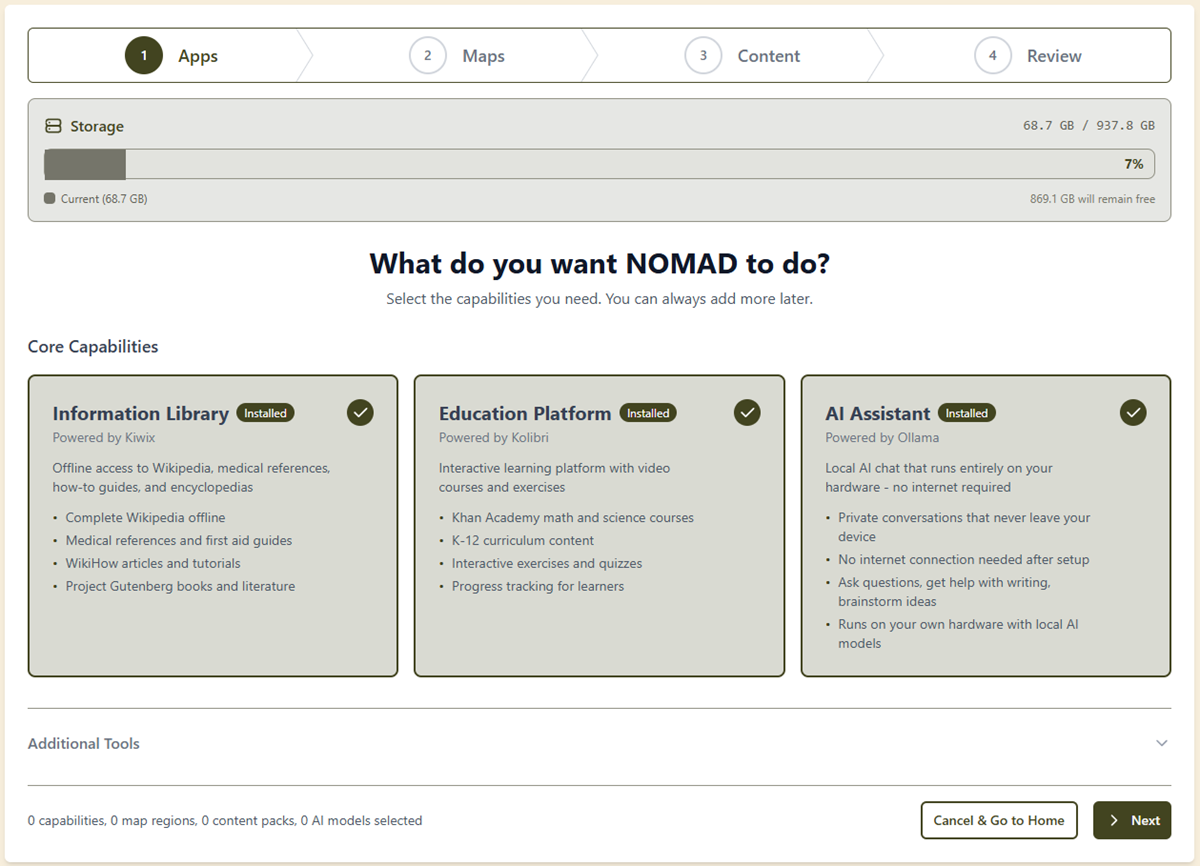

图 1:N.O.M.A.D. 的 Command Center 仪表盘,项目仓库自带文档截图。

它到底把哪些东西装进去了

理解这个项目,最简单的方法不是先记组件名,而是先看它把哪些能力放进了一台机器里。

你装好之后,大概会得到这些东西:

- 一套离线资料库,可以查 Wikipedia、医疗资料、电子书

- 一个本地 AI 助手,可以直接对话

- 一套文档知识库,可以上传 PDF、手册、文本再检索

- 一套离线地图

- 一套课程系统,适合家庭学习或长期离线使用

- 还有笔记、数据处理、硬件跑分这些附加工具

等你把这个能力清单看明白,再去看底层实现就简单了。仓库里对应的组件分别是:Kiwix、Ollama + Qdrant、Kolibri、ProtoMaps、CyberChef、FlatNotes 这些开源项目,再由它自己的 Command Center 统一编排和管理。

这类项目我通常先看两件事:第一,是否真把“离线”当成一等公民;第二,是否只是组件拼盘。N.O.M.A.D. 在这两点上都比我预期更完整。

一方面,它明确写了安装阶段需要联网,后续使用可以离线,而且强调默认零内置遥测。另一方面,它不是让你自己分别运维这些服务,而是用一个管理层把安装、配置、更新、内容下载和状态查看都收进同一个入口里。

上手闭环其实很短

如果你用 Debian / Ubuntu,README 给的安装方式很直接:

装完后默认从 http://localhost:8080 进入。更想自己控参数的话,也可以直接拿仓库里的 management_compose.yaml 手动改成自己的 docker-compose.yml 再 docker compose up -d。

如果是我自己试,我不会一上来就把全套内容都灌进去,而是会先走这个最短闭环:

- 跑安装脚本或 compose

- 打开 Command Center

- 用 Easy Setup 先选最核心能力

- 先下载一小部分内容验证链路

- 再决定要不要上 AI、地图和大体积资源

图 2:Easy Setup 向导会先让你选能力,再决定地图和内容层级。

这一步设计得挺对。因为真正重的不是管理面板本身,而是后续你下载的模型、地图和资料包。

它的核心价值,是把“离线内容”和“离线工作流”接起来了

很多类似项目的上限停在“本地有资料可查”。N.O.M.A.D. 多走了一步:

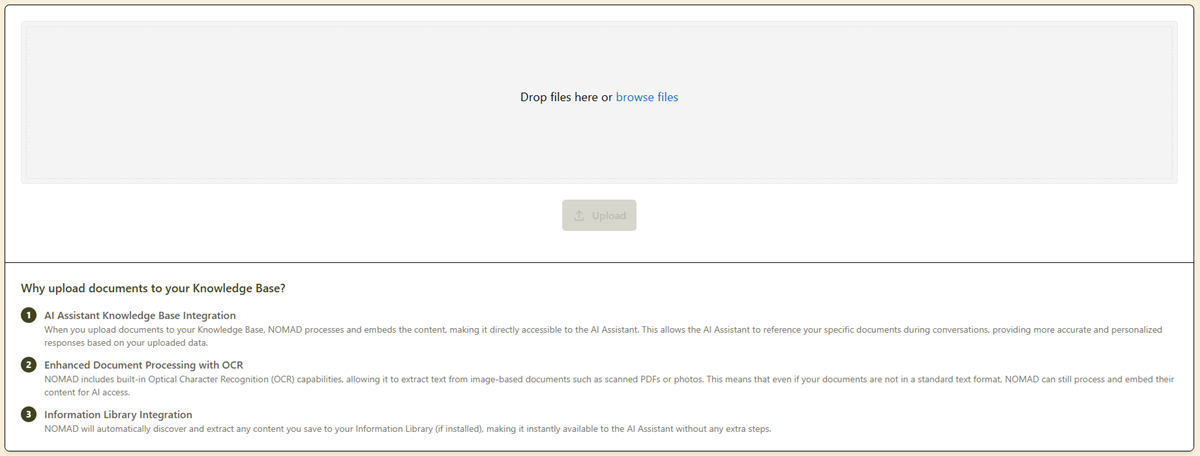

- 你可以把 PDF、文本等文档扔进 Knowledge Base

- 后端用 Qdrant 做语义检索

- 前端直接在内置 AI Chat 里问

- 还支持 OCR、文档删除、嵌入任务队列这些配套能力

也就是说,它想做的不是一个静态资源仓,而是一台能查、能问、能学、能看图、还能继续扩展的离线终端。

图 3:Knowledge Base 支持上传文档后再交给本地 AI 检索和回答。

这对几类场景会特别有吸引力:

- 应急准备 / 断网环境下的资料访问

- 家庭教育或 homeschooling

- 野外、远程工地、船舶、研究站这类网络不稳定场景

- 关注隐私,不想把搜索和问答都交给云服务的人

它不是轻量玩具,硬件预期写得很诚实

这一点我反而挺喜欢。README 没有把它包装成“树莓派插卡即飞”的童话,而是直接把预期拆开了。

如果只装管理层,门槛并不高:2GHz 双核、4GB 内存、5GB 可用空间、Debian 系系统就能起步。

但如果你真想把本地 AI 用起来,仓库建议会上到 Ryzen 7 / Core i7、32GB 内存、RTX 3060 或同级别显卡、250GB 以上 SSD。

这就很真实。项目本身不重,重的是你往里面塞的内容和模型。

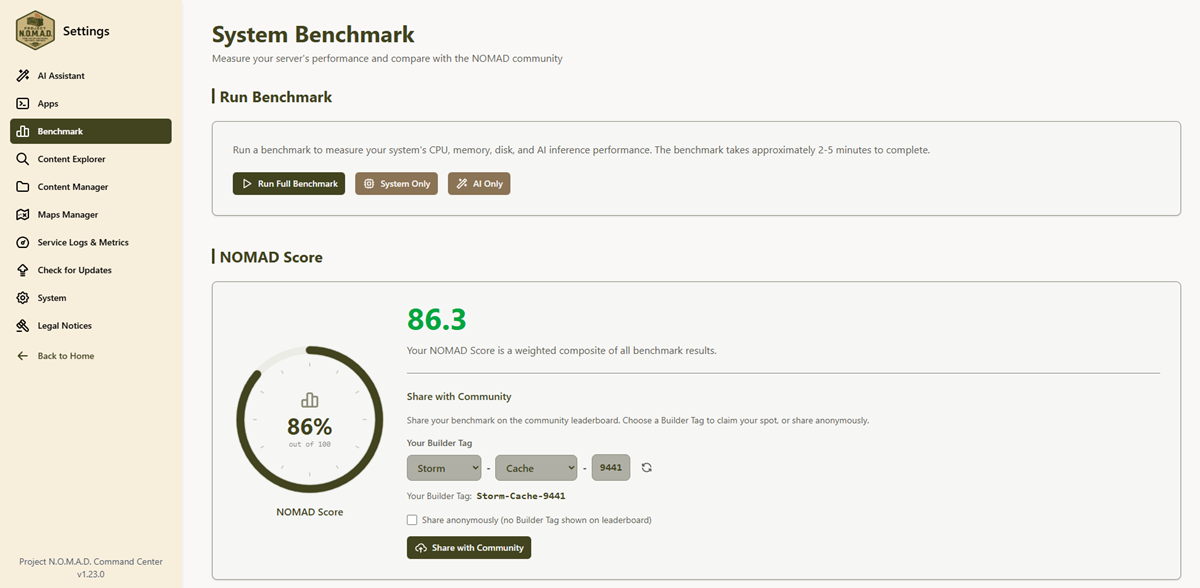

设计上的优点:把复杂度压进统一控制台

从仓库里的 compose 和安装脚本看,N.O.M.A.D. 自己负责的不只是 Web UI。它还把 MySQL、Redis、sidecar updater、disk-collector 和 Dozzle 这些配套组件一起编排进来。

这个思路的好处很直接:用户不用自己手拼一堆面板和脚本,就能在一个入口里管理服务、内容和系统状态。

图 4:项目还内置了硬件 Benchmark 和社区排行榜,不只是“装好就完”。

尤其是最近几个版本的迭代也说明了作者在持续补这层管理体验:1.30.0 加了 Night Ops 深色模式和 Debug Info,修了 GPU 检测、下载失败处理、嵌入任务风暴、存储显示问题,也把 Dozzle 的 shell / 容器动作默认关掉,并去掉 MySQL、Redis 默认暴露端口;1.29.x 则一路在补 AI Assistant 性能、RAG、更新机制和 SSRF、路径穿越防护。

这说明它不是“把几个容器凑一块就不管了”,而是真的在往可维护产品走。

但你也要知道它的边界

这个项目我会推荐给想搭离线信息中枢的人,但不会推荐给所有自托管玩家。几个边界得先讲清楚。

第一,没有内建认证。 README 写得很直白:默认就是开放访问,不带认证。要是你把它挂到局域网里,得自己用网络层控制暴露范围;官方也明确说不建议直接暴露到公网。

第二,它依赖 Docker 和宿主机较高权限。 compose 里 admin 服务挂了 Docker socket,更新器也能写 /opt/project-nomad。这是为了换取“统一管理”的便利,但也意味着这不是一个极端收敛权限的设计。

第三,真正的大头是内容与模型,不是项目本身。 比如 FAQ 里直接给了量级:完整 Wikipedia 大约 95GB,Khan Academy 大约 50GB,AI 模型 10–40GB,不做规划的话,存储很快就上去了。

所以如果你要试,我建议先把目标限定清楚:你到底要的是应急资料库、家庭学习机,还是本地 AI + 知识库的混合终端。先定义场景,再决定装哪些模块。

最后一句

Project N.O.M.A.D. 最值得看的,不是它把多少离线资源堆进一台机器,而是它认真把“断网之后怎么继续工作、学习和检索信息”做成了一套完整产品形态。

如果你只想找个离线 Wikipedia,选项很多。

但如果你要的是一个以浏览器为入口、把离线知识、课程、地图、本地 AI 和内容管理连成一体的开源控制台,这个项目确实有自己的位置。

如果这篇对你有用,建议点个关注。我会持续把 GitHub 上值得用的 AI 工具拆成「最短上手闭环 + 坑点清单 + 可复用配置」,让你少走弯路。

关注微信公众号

想第一时间看到后续的工具拆解与实战更新,欢迎扫码关注公众号。

- 最新评论

- 评论区