别再让一个 AI 猜涨跌了:TradingAgents 把“投研交易部”搬进了大模型

- 对比与选型

- 15天前

- 47热度

- 0评论

如果只让一个大模型看几段新闻、几条 K 线,然后直接回答“这票买不买”,我通常不会太买账。金融判断不是单点问答,更像一套有分工、有冲突、还要过风控的组织流程。

TradingAgents 有意思的地方,就在这儿:它不是做一个“会讲金融黑话”的单代理,而是试图搭一套缩小版 AI 投研交易部。

项目卡

项目名:TradingAgents GitHub:https://github.com/TauricResearch/TradingAgents 最新版本信号:仓库 README 已写明 v0.2.1,补上了 GPT-5.4、Gemini 3.1、Claude 4.6 覆盖,并强调了稳定性改进。 一句话判断:这是一个值得研究的多智能体决策框架,但不该被当成“开源自动炒股机”。

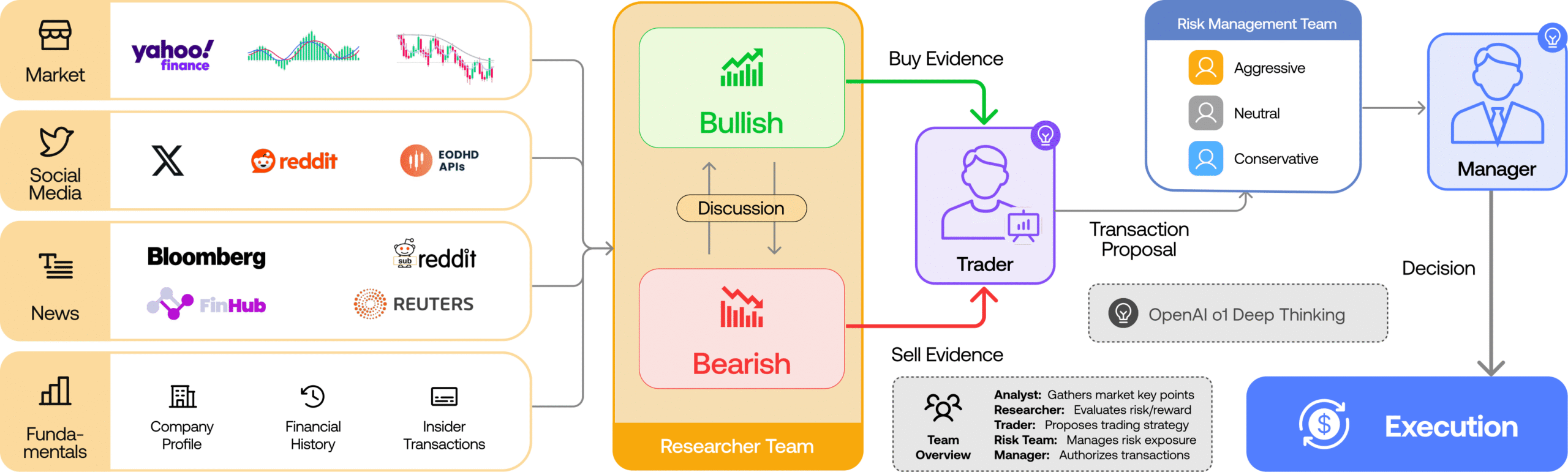

图注:仓库官方架构图。它把分析、辩论、交易、风控和组合管理拆成了不同角色,而不是让一个模型包打天下。

它到底在做什么?

TradingAgents 的核心不是“预测涨跌”,而是把交易决策流程拆成多个专业角色。

前面是四类分析代理:

- 基本面分析师

- 情绪分析师

- 新闻分析师

- 技术分析师

中间再加一层多头 / 空头研究员做结构化辩论,后面接交易员、风险管理和投资组合经理。仓库 README 里把这套链路写得很清楚,代码里也能对上:主类叫 TradingAgentsGraph,默认配置里有 max_debate_rounds、max_risk_discuss_rounds 这类参数,说明作者确实在把“讨论”和“风控”当成流程的一部分,而不是文案装饰。

我会更愿意把它看成一个AI 投研工作流框架,而不是一个交易圣杯。

为什么它比“单模型炒股”更值得看?

第一,它把判断过程摊开了。

单模型方案最常见的问题,是最后只给你一个结论,但你看不清它到底更信新闻、还是更信技术指标、还是被情绪噪声带偏。TradingAgents 至少把这些视角拆开了,后面还能接辩论和审批,过程可观察、也更容易调。

第二,它更像真实机构的协作方式。

现实里的交易决策,本来就不是一个人拍脑袋。研究、执行、风控,本来就是不同岗位。把 LLM 直接当成“万能交易大脑”,我一直觉得太省事了;让不同代理各管一段,再把冲突显性化,反而更合理。

第三,它不只是论文 demo,还保留了可运行框架的味道。

仓库目前能直接走两条路:

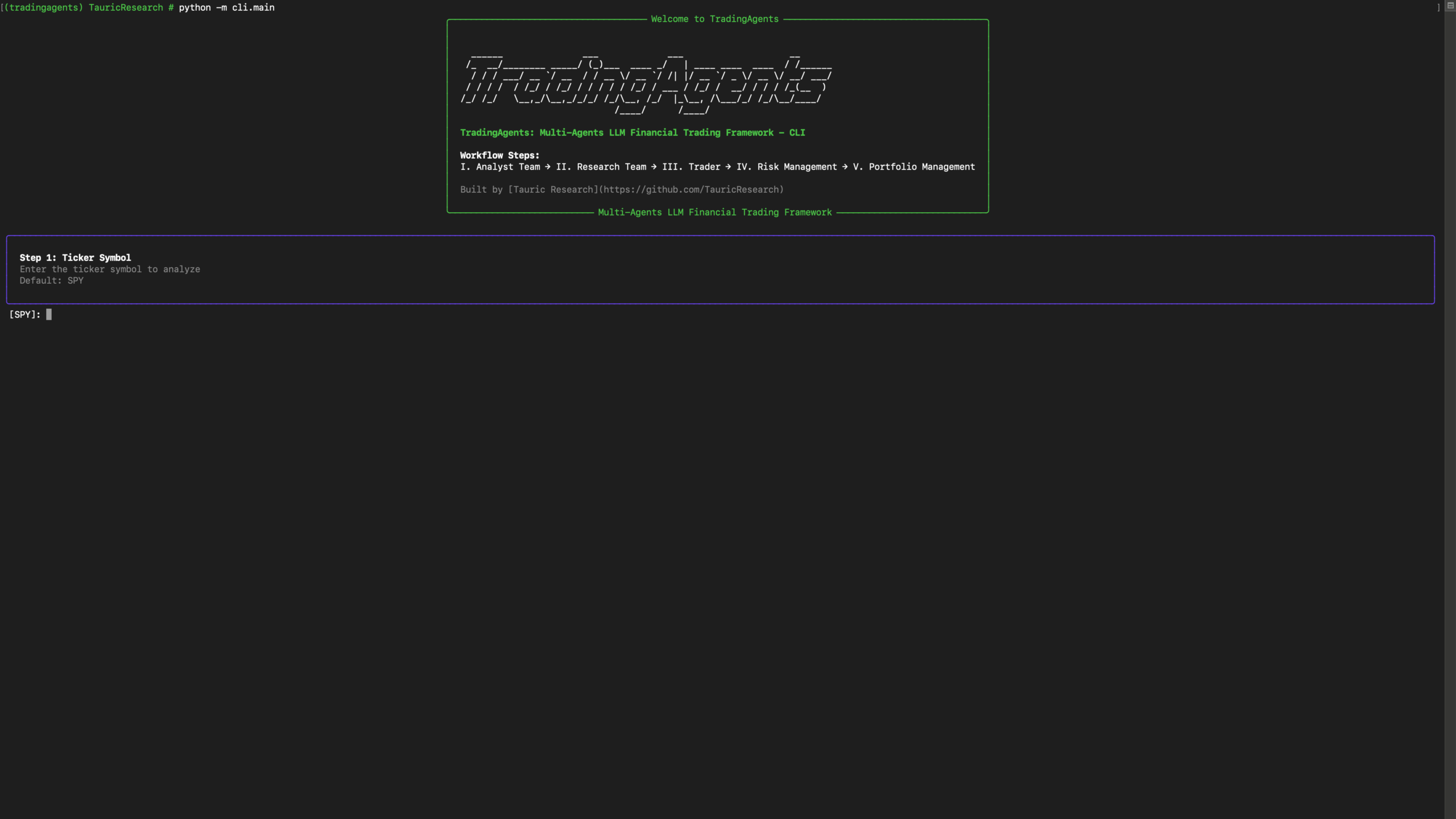

- 命令行:

python -m cli.main - Python 调用:直接初始化

TradingAgentsGraph(),再用.propagate("NVDA", "2026-01-15")跑决策

默认配置文件里还能直接改:

llm_providerdeep_think_llmquick_think_llmmax_debate_rounds

这意味着它更适合被拿来做实验、做对比、做工作流设计,而不是只能围观截图。

图注:仓库官方 CLI 截图。项目不是只有论文描述,还给了交互入口,能选 ticker、日期、模型和研究深度。

最短上手闭环

如果你只是想快速判断它值不值得深挖,可以按这个最短路径走:

1)先把仓库拉下来

2)建环境并装依赖

仓库 README 里给的是 Python 3.13 + pip install -r requirements.txt。依赖里能看到 langgraph、langchain-openai、langchain-google-genai、langchain_anthropic、yfinance、backtrader 这些核心包,说明它的底层确实是“LLM 编排 + 市场数据 + 回测/交易组件”这条路线。

3)配 API Key

它支持的提供商不止一家,README 里明确列了:

默认配置里 llm_provider 是 openai,数据供应商默认更偏 yfinance,但 Alpha Vantage 也留了接口。

4)先跑 CLI,不要一上来改源码

如果是我自己试,我会先用默认参数跑一遍 NVDA 这类高流动性标的,先看它每个角色到底产出什么,再决定值不值得继续往下拆。

这个项目最适合谁?

我觉得更适合三类人:

- 想研究多智能体工作流,而不是只看 agent 聊天的人

- 做 AI 金融研究、想比较不同 LLM / debate 轮次效果的人

- 在做投研产品,想参考“分析—辩论—交易—风控”分层设计的人

如果你只是想找一个“本地跑起来就能稳定赚钱”的开源项目,那大概率会失望。

该泼的冷水还是得泼

仓库自己写得很清楚:研究用途,不构成投资建议。

这不是免责声明式废话,而是这类项目的真实边界。交易表现会被很多变量影响:模型、温度、日期区间、数据质量、提示词、交易周期,甚至每次非确定性输出都可能改结果。

更关键的是,LLM 特别容易在金融场景里制造一种“分析得很像样”的可靠感。它可以把逻辑讲得很完整,但这不等于它真的有稳定 alpha。

所以看 TradingAgents,正确姿势不是问:

“它能不能帮我赚钱?”

而是问:

“它有没有把复杂金融决策这件事,组织得比单代理更像一回事?”

在这个问题上,我的答案是:有,而且值得拆。

最后一句判断

TradingAgents 值得看的,不是它替你做了交易,而是它认真把“谁来分析、谁来反驳、谁来拍板、谁来控风险”这条链路搭出来了。

这套思路不只适用于金融。凡是高不确定、强分工、需要审议的任务,multi-agent 可能都该按“组织”来设计,而不是按“一个更聪明的机器人”来设计。

如果这篇对你有用,建议点个关注。我会持续把 GitHub 上值得用的 AI 工具拆成「最短上手闭环 + 坑点清单 + 可复用配置」,让你少走弯路。

关注微信公众号

想第一时间看到后续的工具拆解与实战更新,欢迎扫码关注公众号。