12k+ Stars,promptfoo 想解决的不是 Prompt 调试,而是 AI 应用测试

- Prompt / Skills / 配置

- 2026-03-12

- 59热度

- 0评论

项目拆解

12k+ Stars,promptfoo 想解决的不是 Prompt 调试,而是 AI 应用测试

这是一篇面向技术读者的项目拆解稿:优先讲清它为什么值得看、底层机制是什么、最短能学到什么,而不是只给你一堆热闹功能点。

项目卡片

- 项目名:promptfoo

- GitHub:https://github.com/promptfoo/promptfoo

- 当前 Stars:12,231

- 热度参考:总星数已超过 1.2 万,最近也还在继续涨

- 一句话判断:如果你已经不满足于“手动试几个 prompt 看看”,那 promptfoo 基本就是下一步该上的东西。

如果你把 promptfoo 理解成“又一个 Prompt Playground”,那会低估它。

我把 README、getting started、red team、code scanning 文档连着看完,又翻了示例配置和部分命令实现后,最明确的判断是:promptfoo 真正想解决的,不是提示词怎么调得更顺手,而是 AI 应用上线前到底怎么测、怎么回归、怎么卡门禁。

说得再直白一点: 很多工具解决的是“试一试”,promptfoo 解决的是“系统地测一遍”。

图:这类工具真正有用的时刻,不是试玩,而是你开始把 AI 能力纳入可回归的工程流程。

为什么值得看?因为它盯上的不是 Prompt,而是“上线前的确定性”

promptfoo 在 README 里的定位很直白:它是一个用于 evaluating and red-teaming LLM apps 的 CLI 和 library。

这句话看起来普通,但含义很重。

它测试的对象,不只是一段 prompt 文案,而是更完整的一层:

- 你选的模型对不对

- 你的提示词版本有没有退化

- RAG 输出是否稳定

- Agent 接工具以后有没有越权、泄露、跑偏

- 这些东西能不能进 CI/CD,而不是靠人肉 review

官方文档里还有一句我很认同:test-driven LLM development, not trial-and-error。

这基本就是 promptfoo 的核心世界观。

现在大量团队做 AI,流程还是这样:

- 改一句 prompt

- 点几次 playground

- 截几张图

- 群里讨论“好像更好了”

- 上线后再看用户骂不骂

这种流程短期能跑,规模一上来一定出问题。

因为 AI 应用最烦的,不是第一次做出来,而是第二十次改动以后,你已经说不清到底哪里变好了,哪里其实退了。

它和常见 Prompt Playground / 轻量 eval 工具有什么区别?

我觉得最关键的差别有 4 个。

1)它把配置当成源文件,不把截图当证据

promptfoo 的最小单位是 promptfooconfig.yaml。

你在里面定义:

- prompts

- providers

- tests

- assertions

- 并发、缓存、输出等运行参数

这意味着你的测试对象是可复现的。

不是“我昨天在某个网页里点过一次,感觉 Claude 比 GPT 更稳”,而是“这组输入、这批断言、这几个模型,今天跑和下周跑,标准是同一套”。

2)它不止比输出,还能自动判分

很多对比工具停在“把回复并排摆出来”。

promptfoo 往前走了一步:它支持 assertions。

既可以做确定性检查,比如 contains、regex 这种;也可以做更复杂的模型评分、事实性、上下文相关性、工具调用等判定。

这件事的意义很大。

因为你一旦有了断言,AI 测试就从“主观观感”变成“可以卡门禁的检查项”。

3)它不是只测 prompt,而是一路延伸到 RAG、Agent、红队

promptfoo 官方文档把 eval、red team、code scanning 都放在同一条产品线上。

这就是我觉得它比很多 eval 项目更值得看的地方。

它的思路不是: “这里有个漂亮界面,方便你看回复。”

而是: “既然 AI 应用已经进入工程栈,那质量、安全、回归、PR 检查也该一起进工程栈。”

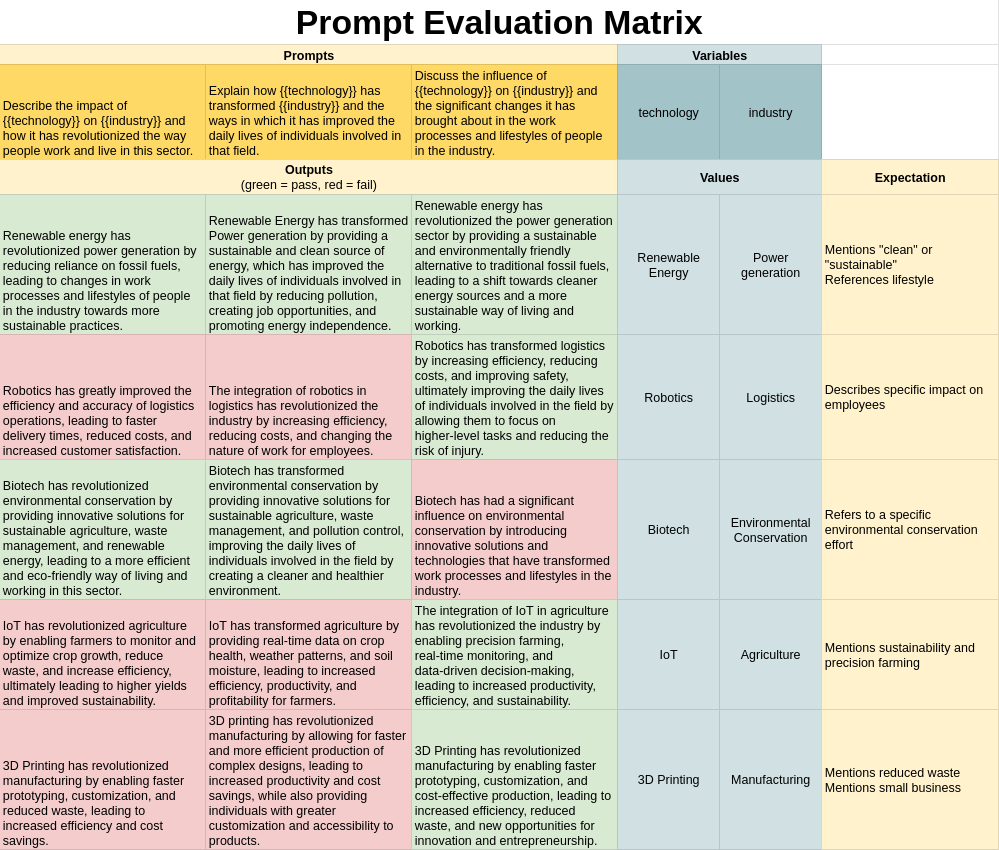

图:这是 promptfoo 很典型的矩阵式评测视角。它强调的是批量比较和结构化判断,不是单轮试玩。

4)它明显是冲着 CI/CD 去的

README 和文档都反复提到 CI/CD 集成。

这点特别关键。

很多团队以为自己缺的是“更强的 prompt 工具”,其实缺的是: 每次改模型、改提示词、改检索链路以后,能不能自动知道自己把什么改坏了。

promptfoo 正是在补这块。

所以如果非要给一句最短定义,我会这么说:

promptfoo 不是替代聊天式 playground 的,它更像是 AI 应用的测试台。

最短上手闭环很短,这也是它这波涨得快的原因

它的上手门槛其实比想象中低。

官方给的最短路径是:

这个 getting-started 示例本身也很克制。

本质上就是一份 YAML:

- 一条带变量的 prompt

- 两个 provider

- 两组测试输入

- 每组测试配断言

比如示例里,你能很直观地看到这样的结构:

如果你能接受“用 YAML 描述测试”,那你基本 10 分钟内就能把第一轮 eval 跑起来。

这里我觉得它做对了一件事: 先把闭环做短,再把能力做深。

你可以先把它当成多模型对比工具用;但随着测试集、断言、provider、CI 接入越来越多,它会自然长成团队级基础设施。

promptfoo 真正拉开身位的地方,在安全这半边

只讲评测,其实市场上已经很挤了。

promptfoo 更特别的,是它把红队和代码扫描也做进来了。

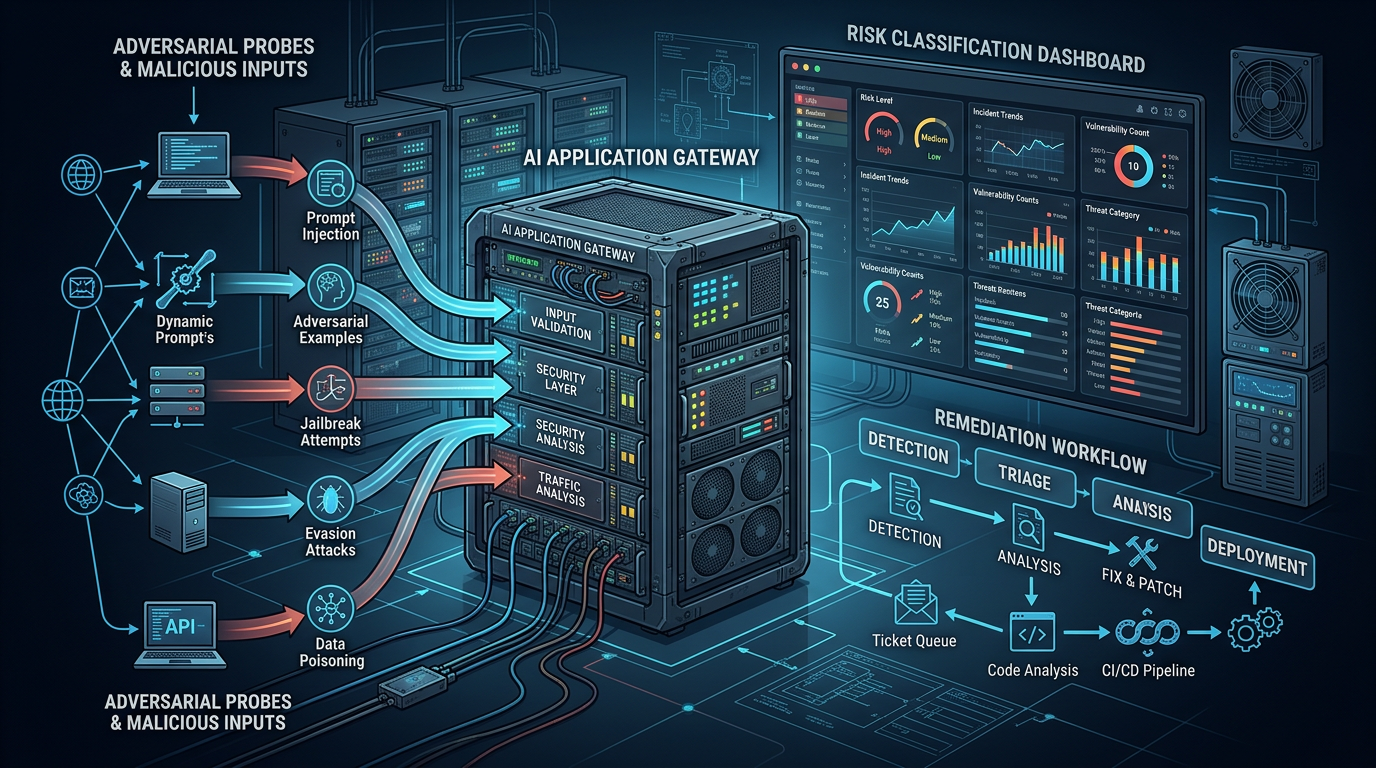

官方红队文档讲得很清楚:它要做的是系统化的 adversarial testing,用自动生成的对抗输入去测越权、泄露、提示注入、误用等问题,并尽量量化风险。

这和很多人理解的“安全测一下”不是一回事。

它更像是在把传统 AppSec 思路迁到 AI 应用层:

- 一次性做报告

- 或者把它挂进 CI/CD 持续跑

- 重点盯应用层威胁,而不只是模型表面的安全回答

图:AI 安全测试的重点,不是喊几句“注意风险”,而是把攻击面、探针和结果评估变成可重复流程。

更进一步,它还有 code scanning。

这个模块的思路也很有意思:不是泛泛扫代码风格,而是专门盯 LLM 相关风险,比如 prompt injection、PII 暴露、excessive agency 这类问题,并强调会沿数据流往里追,而不是只看表面 diff。

如果你现在做的是:

- RAG 产品

- 带工具调用的 Agent

- 内部 Copilot

- 会接数据库、工单系统、知识库的 AI 应用

那这一层能力就不是“锦上添花”,而是越来越接近刚需。

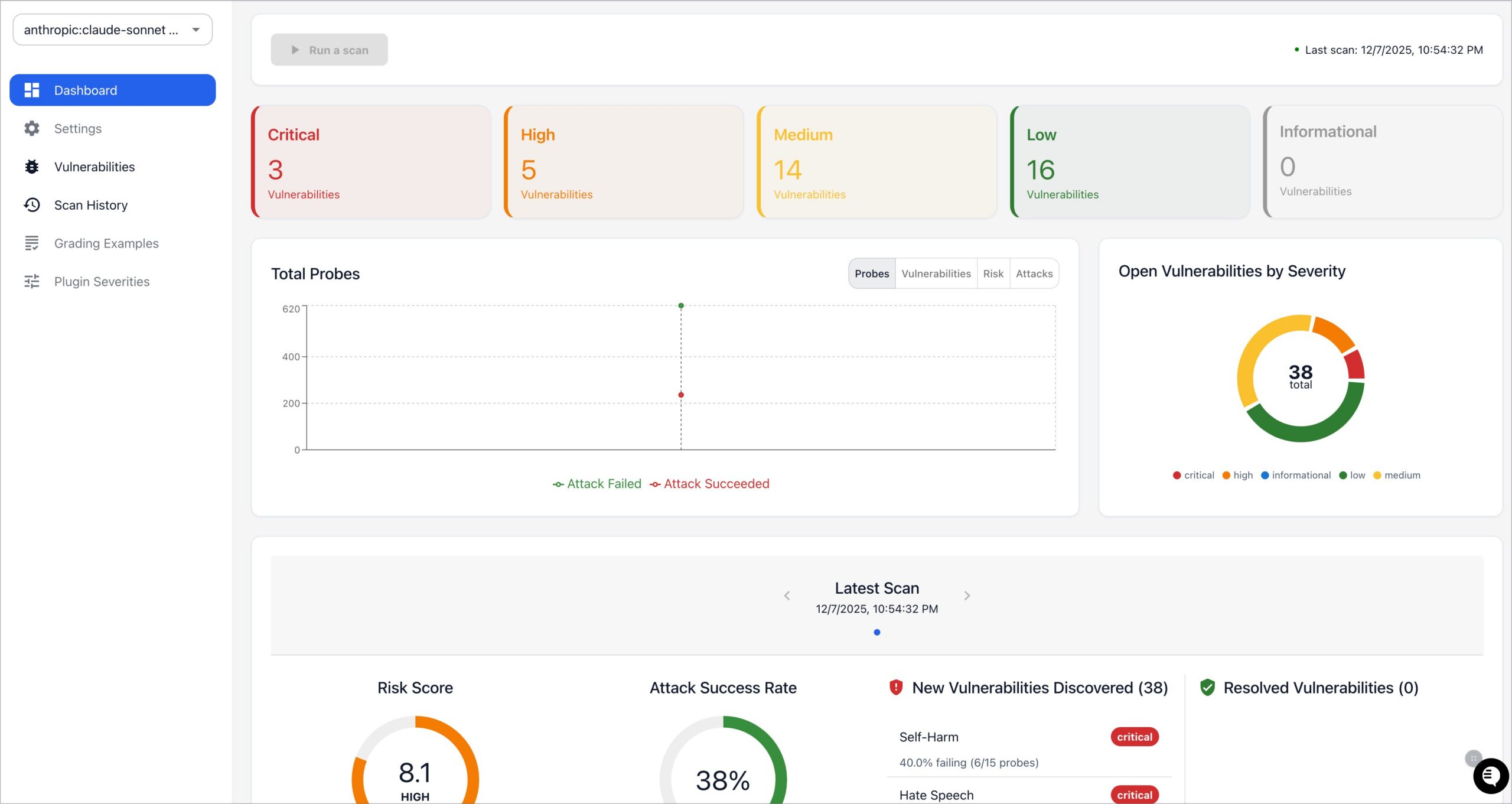

图:红队报告界面能看出 promptfoo 的落点很明确——不是单次试玩,而是风险量化和持续治理。

它适合谁,不适合谁?

适合这几类团队

- 已经在做真实 AI 产品,而不是只做 demo

- 需要比较多个模型、多个 prompt 版本

- 有 RAG / Agent / tool calling 场景

- 想把评测和回归纳入发布流程

- 对 AI 安全、越权、泄露开始有压力

不那么适合这类情况

- 你只是临时试一句 prompt

- 团队还没有稳定输入样本,也没有明确评判标准

- 现阶段连最小业务闭环都没跑通

换句话说,promptfoo 不是“人人都必须装”的项目。

但只要你已经进入“AI 功能要长期维护”的阶段,它就会变得很顺手。

最后一句判断

我会把 promptfoo 归到那种看起来像工具,实际上是在卖方法论的项目里。

表面上你拿到的是:

- eval

- red team

- code scanning

- CLI / Web UI / CI 集成

但更重要的是它背后的那套判断:

AI 应用不该继续靠试错推进,而该像正常软件一样,被测试、被回归、被量化、被审计。

这也是为什么它最近这波涨星,我觉得不是纯热度驱动。

它踩中的,正是团队从“把 AI 接进产品”走向“把 AI 管进工程”的那个节点。

如果你现在已经被 prompt 回归、模型切换、RAG 漂移、Agent 越权这类问题折腾过,建议直接去看这个仓库: https://github.com/promptfoo/promptfoo

如果这篇对你有用,建议点个关注。我会持续把 GitHub 上值得用的 AI 工具拆成「最短上手闭环 + 坑点清单 + 可复用配置」,让你少走弯路。

关注微信公众号

想第一时间看到后续的工具拆解与实战更新,欢迎扫码关注公众号。